个人简介

姚鸿勋,教授,计算机视觉智能研究组负责人,黑龙江省特殊津贴专家,教育部新世纪优秀人才,校优秀博士生导师,中国图象图形学学会优秀博士论文指导教师,人工智能专业负责人。先后主持国家自然科学基金重点、国家自然基金、国际合作等二十余项,在领域顶级会议CVPR、ICCV、MM和顶级期刊IEEE TPAMI、IEEE TIP等上发表论文60余篇,有多篇是高被引文章,并被列入全球人工智能领域顶尖2000人物榜单。

代表项目

1. 群体行为意图分析

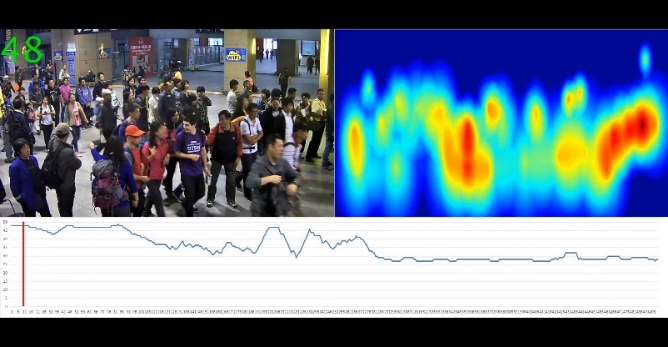

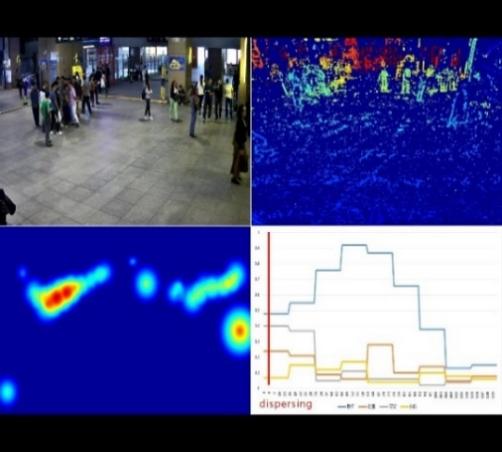

国家自然基金重点项目,针对多源群体视频、无线信号,对群体目标行为进行特征提取与识别,预测和挖掘群体行为意图。包括群体目标检测、群体行为分析等。如图1所示为群体目标在视频中的检测和定位结果。图2为高密度人群的密度估计热力图,第二行的曲线表示各帧中所包含的群体目标个数。如图3第一行表示RGB视频数据和深度视频数据,右下角表示群体行为意图的置信度计算,而图4则用不同颜色区分挖掘到的群组。

△ 群体目标检测 △ 群体目标密度变化计算

△ 群体行为意图分析 △ 群组分析

2. 图像视频检索系统

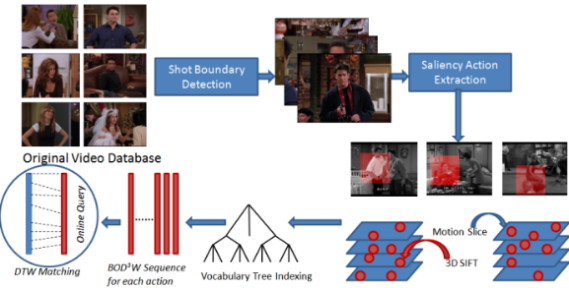

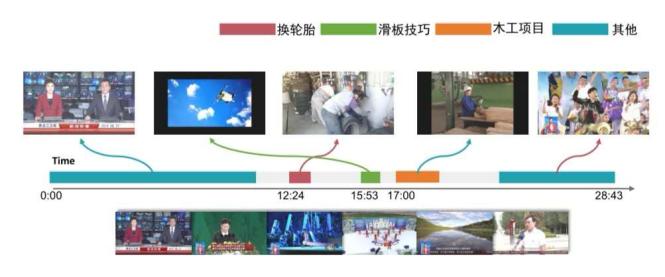

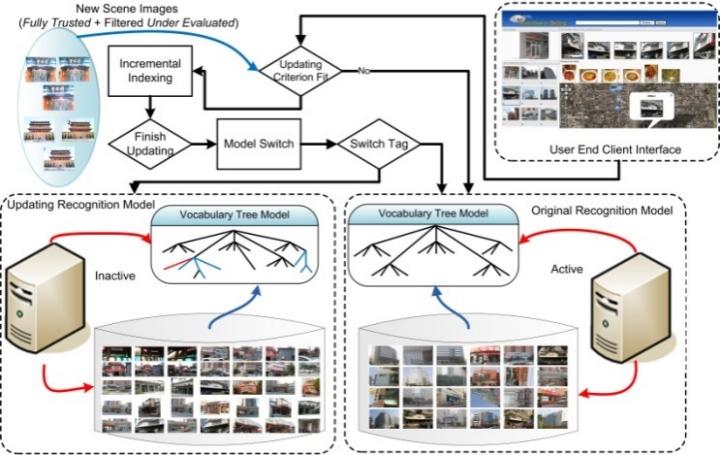

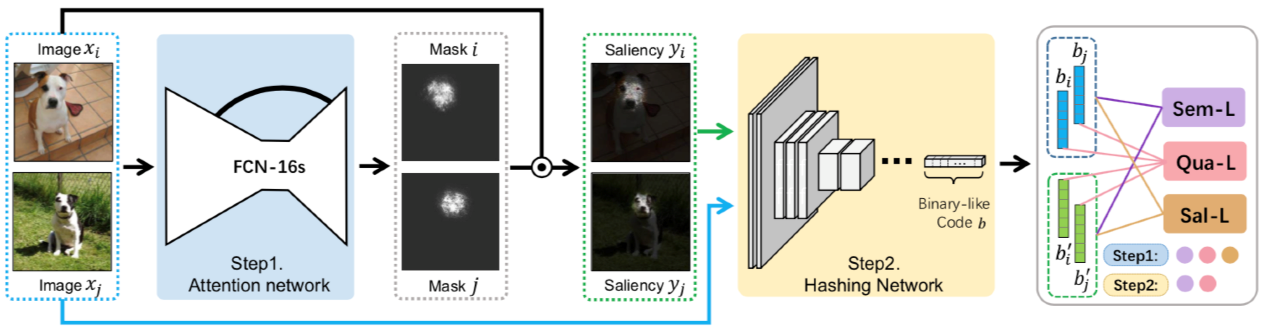

973、863子课题、自然科学基金等,解决关注区域模型、语义特征提取、词汇树偏赘分布,以及新数据集的迁移学习等问题,完成了金融数据库、信息移动平台等的应用系统。此外,利用深度显著哈希额网络,完成海量目标的快速定位及检索任务。还完成了基于草图的物体检索,和利用三维物体模型的立体检索应用。

△ 视频中的动作抽取与索引流程 △ 新闻视频自动分割

△ 增量索引模型

△ 深度显著哈希网络

3. 3D模型重建与数据生成

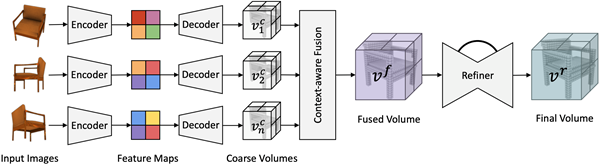

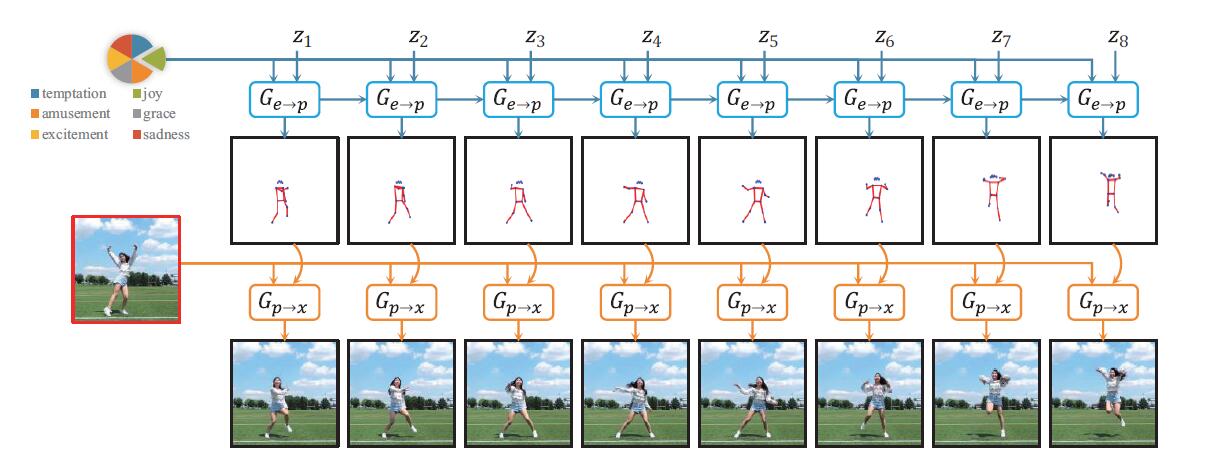

自然科学基金等,可以从任意长度的输入图(单视或多视图)重建物体的三维模型,克服三维重建方法对特征严重依赖性,也解决弱纹理或视图差异大情形下的特征匹配问题。以及基于姿态迁移的真实三维感的动作视频生成。通过将原有的图像中人的姿态迁移成为目标姿态,生成新的目标姿态序列,如图10中所示。还可以根据特定情感,按如图11所示结构.生成带情感的动作视频。

△ Pix2Vox: 基于上下文感知的3D重建网络

△ 基于人体姿态迁移的动作视频生成

△ 基于情感表达的动作视频生成原理图